不同行业往往有对应的主管部门或行业协会,这些机构通常设有专门的投诉受理机制,处理效率较高,且具有一定的行业约束力。比如:

如何把「大象」塞进雪柜?

这恰是当代智能援救驾驶正在勉力完成的一个命题。

咱们但愿车子能领有一个像爱因斯坦一样理智的超等大脑,但现实的窘态是:

你不行能在后备箱里塞进一个需要液冷的奇迹器机柜!

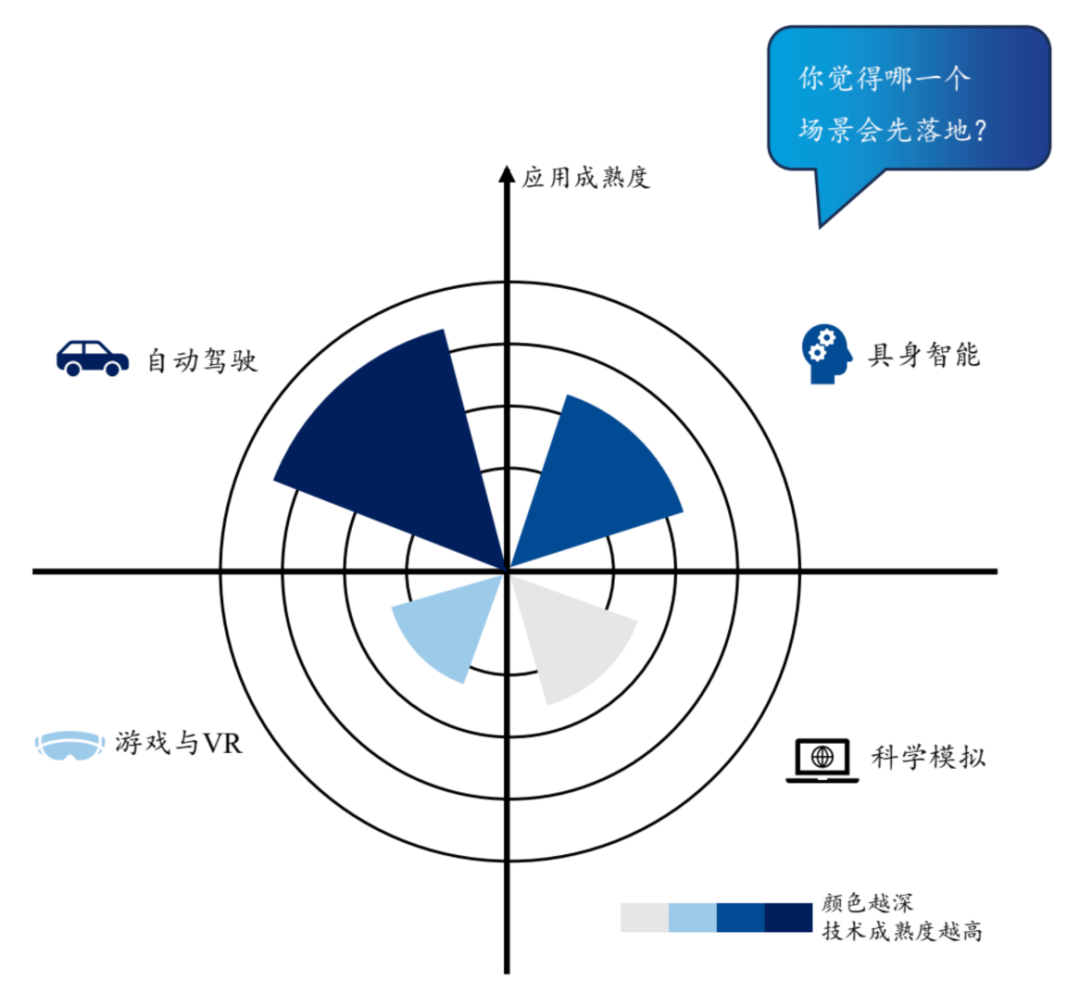

当云表大模子正在加快冲刺AGI的同期,具身智能、智能驾驶等真什物理场景却正面对着一个隐性的雄壮惊愕:「小」。

如何把「大模子」塞进极其有限的「小空间」车载芯片或机器东谈主适度中枢里?

这即是现在智能驾驶、具身智能、VR等领域碰到的一个现实问题:

被一块小小的芯片「卡住了脖子」。

智能驾驶正在迈向全场景智能,但车载算力平台撞上了一个中枢悖论:

比如,一个在云表GPU上10毫秒就能完成的推理任务,到了车载芯片上可能要300毫秒。对自动驾驶来说,300毫秒意味着车辆在高速上「盲开」了好几米。

系数巨头,英伟达、苹果、微软、谷歌皆在想办法。

然而第一个给出表面级谜底的,是一家中国车企。

2026年2月,瞎想汽车基座模子MindVLA团队与国创决策智能技巧议论所辘集发布了一篇论文:《Hardware Co-Design Scaling Laws via Roofline Modelling for On-Device LLMs》。

提倡了面向端侧大语言模子的「硬件协同想象彭胀定律」。

论文地址:https://arxiv.org/abs/2602.10377

论文地址:https://arxiv.org/abs/2602.10377这篇论文直面了面前最中枢的挑战之一:

如何将越来越刚劲的大语言模子高效地部署在资源受限的「端侧开辟」(如汽车、手机、机器东谈主)上。

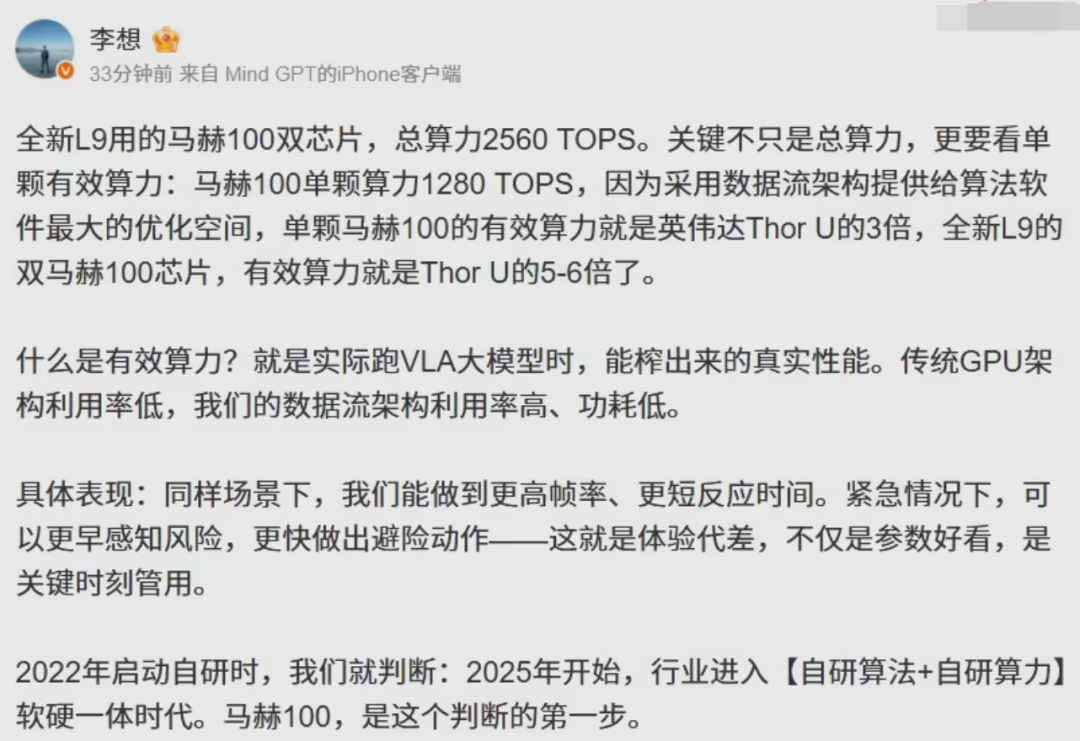

提到瞎想汽车,大批东谈主的第一响应如故「增程式电动车的代表」。但扫视其近两年的技巧布局:自研5nm车规芯片马赫100、开源操作系统星环OS、自研基座大模子MindVLA、端到端智驾全栈自研。

瞎想正在从一家以增程技巧见长的汽车公司,转念为一家以智能驾驶和具身智能为中枢的AI公司。

而这篇刚刚发布的论文,是说合这场转型最佳的注脚。

]article_adlist-->

]article_adlist-->大模子「上车」,卡住了!

如何将现在「起原进的AI」装入汽车?

这里会遭受了一个雄壮的矛盾:

一方面,但愿车载AI模子尽可能地舆智、响应飞速,以确保驾驶安全和通顺的交互体验。这要求模子范围大、结构复杂。

另一方面,汽车里面的谋划单位(芯片)受到严格的物理扬弃,包括功耗、散热、内存大小和本钱。这要求模子必须工整、高效。

传统的作念法时常是「模子归模子,硬件归硬件」。

AI议论者想象出性能刚劲的模子,然后由工程师想办法在硬件上进行优化和「塞入」。

这种样式后果低下,且时常无法达到确切的最优。

这就好比为一个F1赛车引擎想象了一个巨型卡车的底盘,二者无法无缺匹配,引擎性能大打扣头。

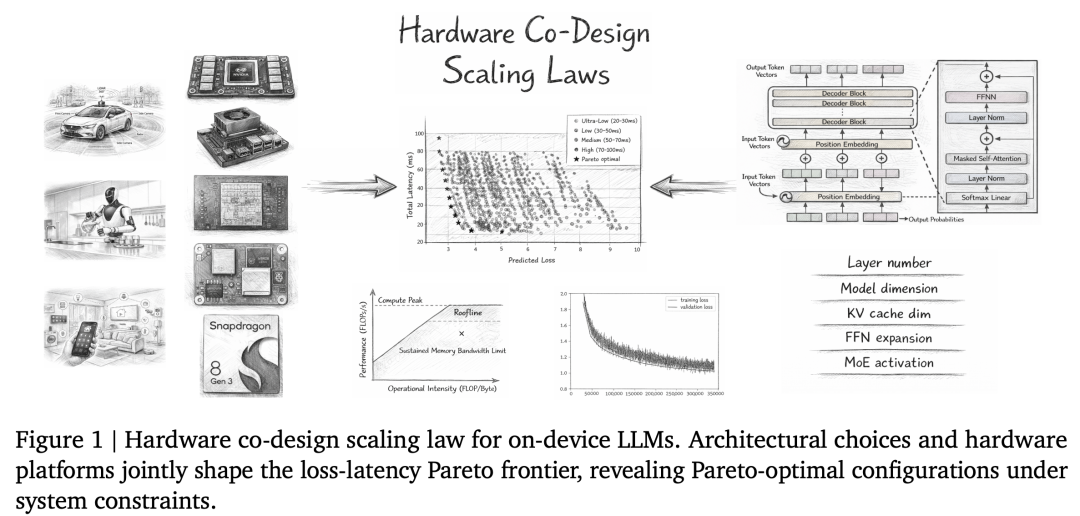

而瞎想这篇论文恰是为了搞定这个「失配」问题,他们提倡了一套系统性的循序:

在想象模子之初就将硬件的能力洽商进来,竣事「软硬协同想象」(Hardware Co-Design)。

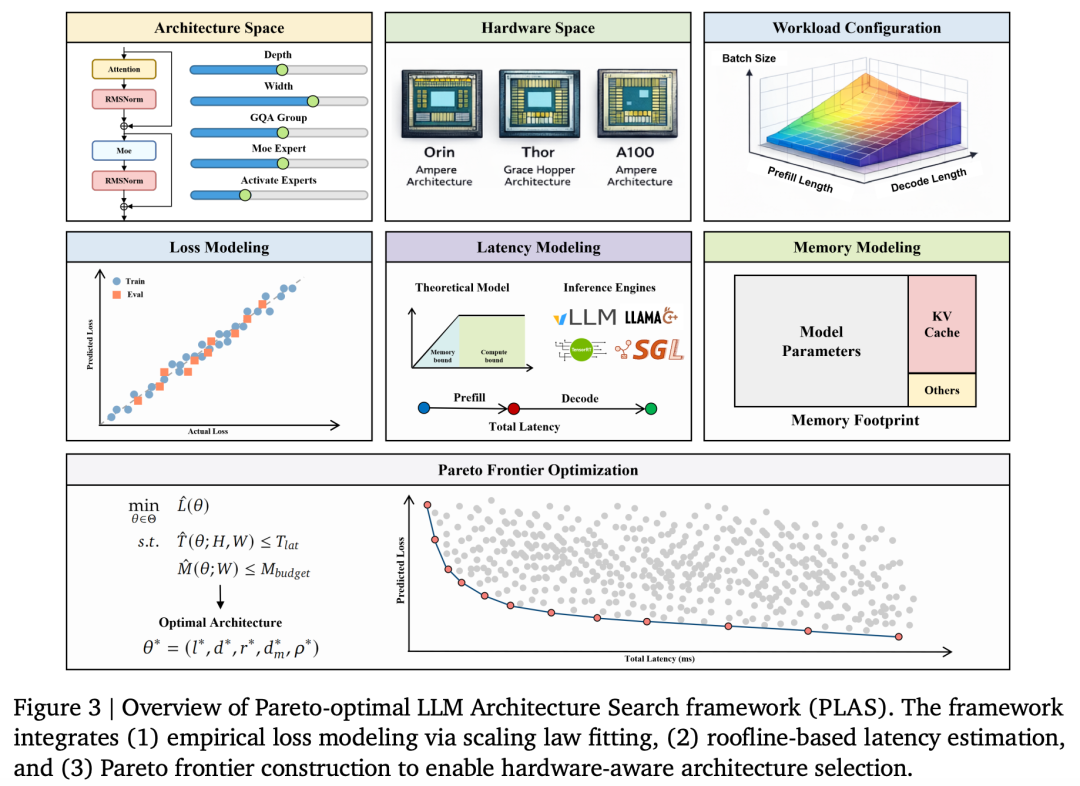

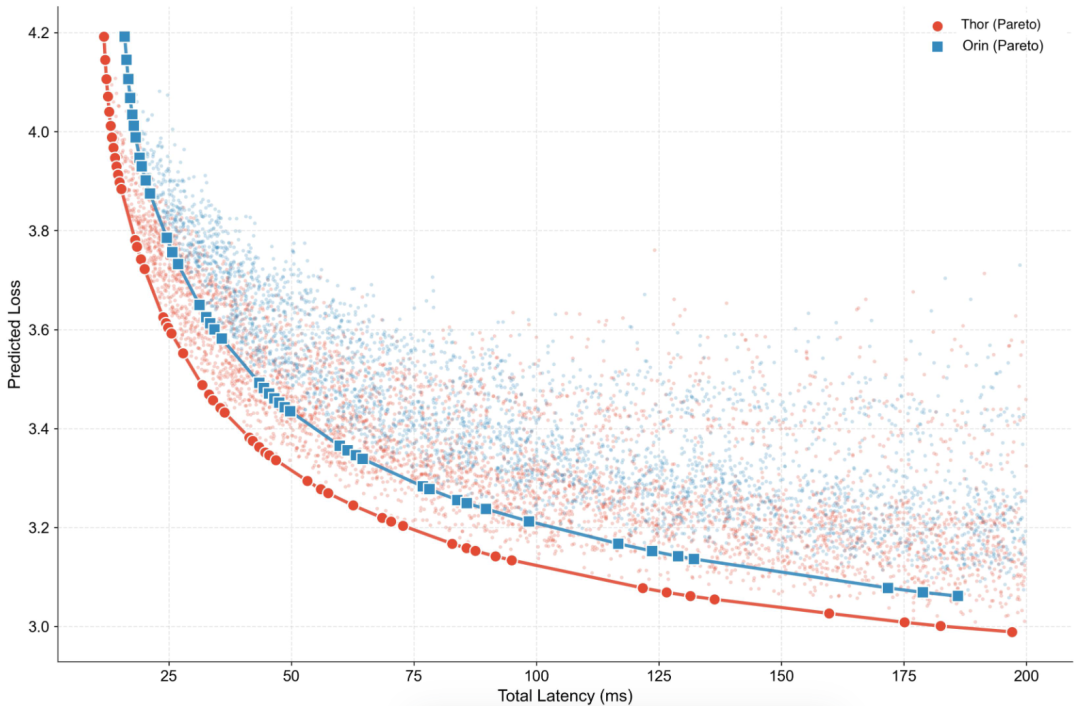

架构聘任(右侧)与硬件平台(左侧)共同塑造亏蚀-延长帕累托前沿

架构聘任(右侧)与硬件平台(左侧)共同塑造亏蚀-延长帕累托前沿 ]article_adlist-->

]article_adlist-->软硬协同:逢迎模子与硬件的桥梁

如何量度模子的「奢睿」?

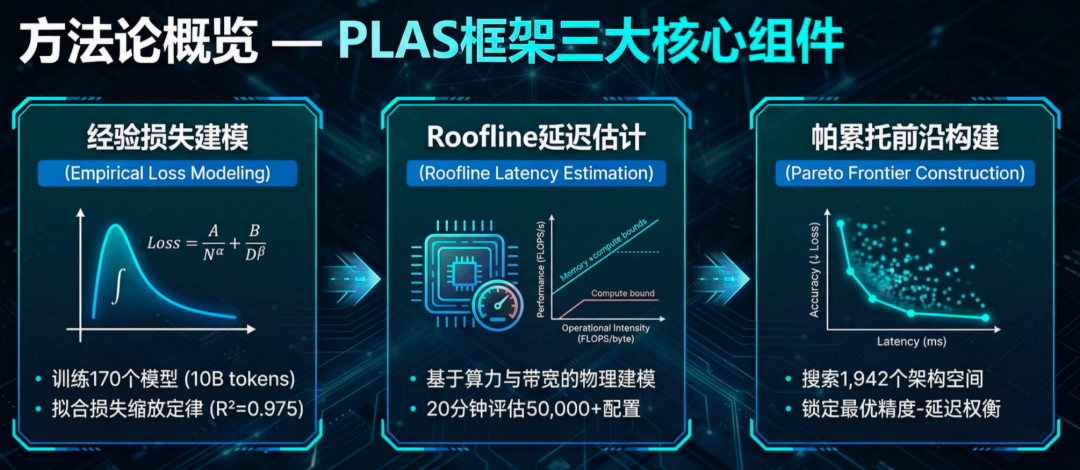

先来简便先容下什么是亏蚀-延长帕累托前沿。

在AI领域,「亏蚀」是量度模子预计与真实谜底之间偏差的磋议。

亏蚀越低,模子预计越准确,代表它越「理智」、精度越高。你不错把它说合为「责任质料」。

延长指的是AI给出响应需要多永劫刻。延长越低,速率越快,代表它能作念到「秒回」。你不错把它说合为「责任速率」。

帕累托前沿是一个经济学见解。

普通地说,当你追求既要「质料高」(低亏蚀),又要「速率快」(低延长)时,你会遭受一个物理极限。

到了这个极限景况后,你不行能在不糟跶速率的前提下,让AI变得更理智;也不行能在不糟跶理智度的前提下,让AI跑得更快。

系数这些「最优的折中点」连起来的一条线,就叫「帕累托前沿」。

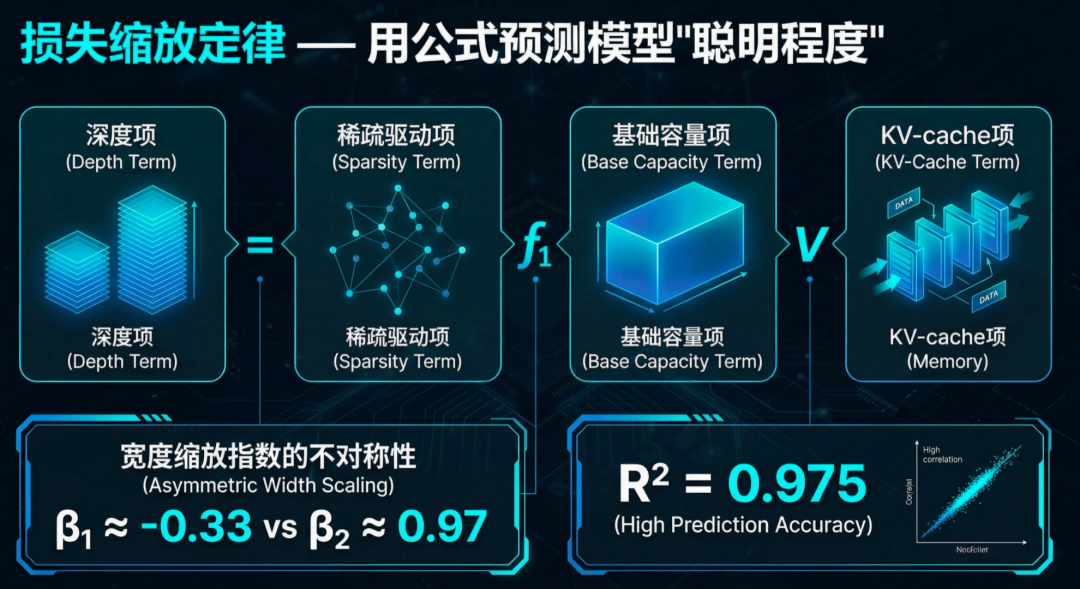

瞎想团队发现,模子的最终亏蚀与其架构超参数(如网罗深度、宽度、大家数目等)之间存在着可预计的数学关系。

通过对这个关系进行精确建模,就不错在作假际磨真金不怕火的情况下预计模子性能。

团队作念了一件极其塌实的事——真的训了170个不同架构的Transformer模子,每个用100亿token磨真金不怕火,隐蔽Dense(密集)和MoE(羼杂大家)两大类,层数4到48,宽度256到4096,MoE大家数1到64。

目的即是拟合一条精度预计公式:

给定苟且一组架构超参数,径直预计考证亏蚀——无用真的磨真金不怕火。

要道数据:拟合精度达到R²=0.975(磨真金不怕火集)和R²=0.952(32个全新架构的考证集)

要道数据:拟合精度达到R²=0.975(磨真金不怕火集)和R²=0.952(32个全新架构的考证集)在同期包含密集和稀少模子的异质架构空间中,这个预计精度极其惊东谈主。

模子有多理智,算一下就知谈。

普通地说,瞎想团队找到了一个「谋划器」,输入一个模子的想象决策,就能算出这个模子表面上能有多理智。

如何量度硬件的「性能」?

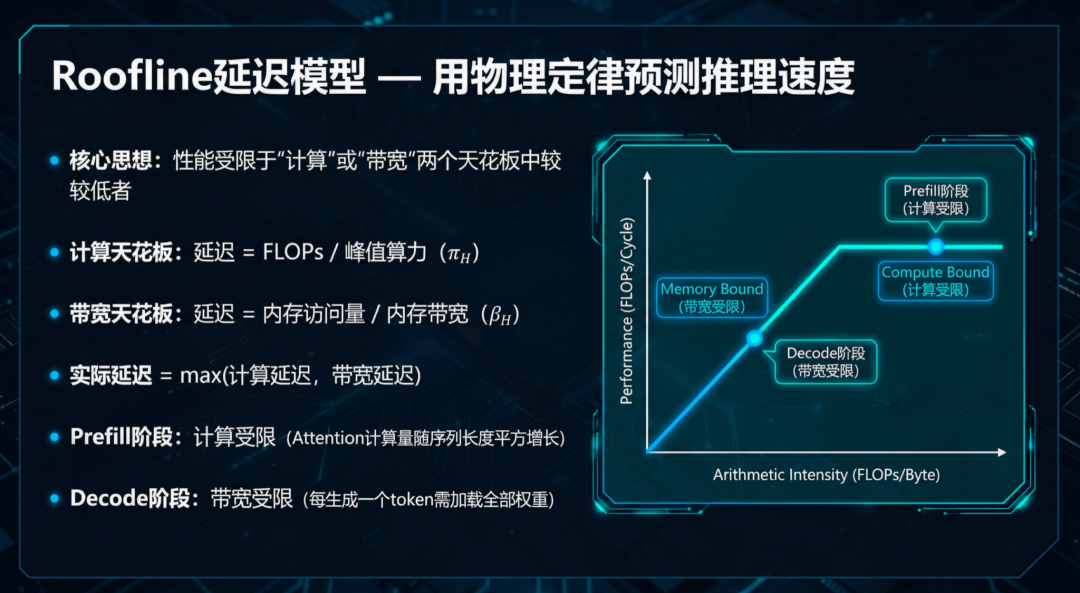

关于一块芯片而言,决定其运行速率的要道成分有两个:

峰值谋划能力 (FLOPS):芯片每秒能奉行若干次浮点运算,如同工场的出产线速率。

内存带宽 (Bandwidth):芯片每秒能从内存中读取若干数据,如同工场的物料供应速率。

一个要领的运行速率,取决于它究竟是被「谋划」卡住了瓶颈,如故被「内存读取」卡住了瓶颈。

Roofline模子恰是这么一个经典的性能分析器用。

它不错左证一个任务的谋划量和内存访谒量,以及硬件的上述两个参数,精确地预计出该任务的表面运行时长,即「延长(Latency)」。

瞎想团队诈欺Roofline模子也造了一个「谋划器」,输入一个模子和一个硬件平台,就能算出模子在这块芯片上跑一次需要多永劫刻。

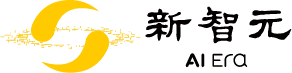

团队基于经典的Roofline模子,从第一性旨趣推导了Transformer端到端推理延长的完整数学抒发。

议论团队十分针对车载场景作念了要道彭胀:

初度系统建模了KV缓存、MoE路由、留神力机制等大模子独特负载对车载SoC内存子系统的影响,在Jetson Orin/Thor平台上考证了普适性。

这个延长模子有多高效?

20分钟内就不错评估5万+种架构建立。

模子跑多快,也算一下就知谈。

合二为一:帕累托最优搜索

接下来即是辘集优化。

团队开发了PLAS框架(Pareto-optimal LLM Architecture Search):

给定芯片的算力、带宽和内存管理,自动找到使亏蚀最小、同期延长不超主见最优架构。

解集组成一条帕累托最优前沿——前沿上每个点,皆是该延长预算下能达到的最低亏蚀。

你不行能在不增多延长的情况下裁减亏蚀,也不行能在不增多亏蚀的情况下减少延长。

这即是「软硬协同想象定律」的本色:将模子精度和推理后果援救在并吞数学框架下的辘集优化表面。

这亦然论文最硬核的部分:在不同硬件管理下,最优模子架构参数存在闭合解。

无需磨真金不怕火,给定芯片参数,径直算出模子架构最优解。

以下是团队推导出来的三个要道定理。

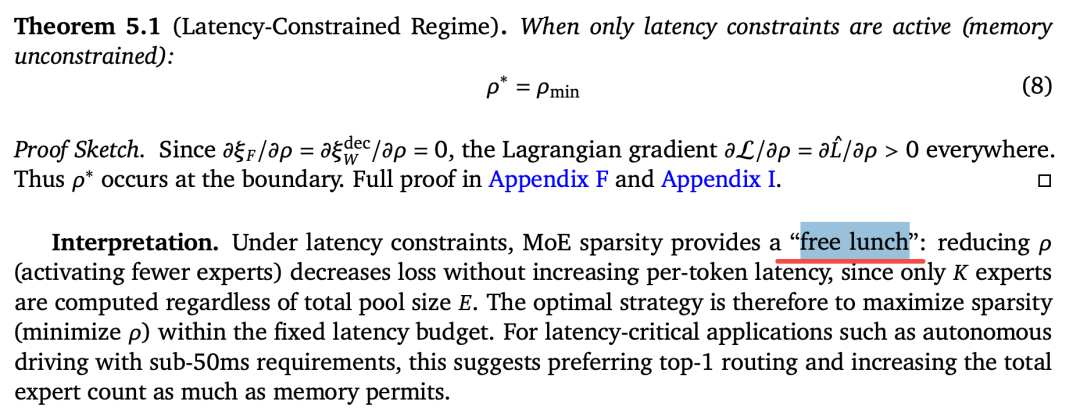

定理一:延长管理下的「免费午餐」。

芯片速率是瓶颈,股票配资软件内存充裕(如车载高端平台)的场景下。

MoE大家越多、每次激活越少越好。

为什么叫「免费」?MoE中不论所有若干大家,每个token只激活K个来谋划。

增多总大家数统统不影响推理延长,但模子容量实打实增多了。

对自动驾驶的启示:在sub-50ms极限延长下,应采纳top-1路由,内存允许范围内最大化大家池。

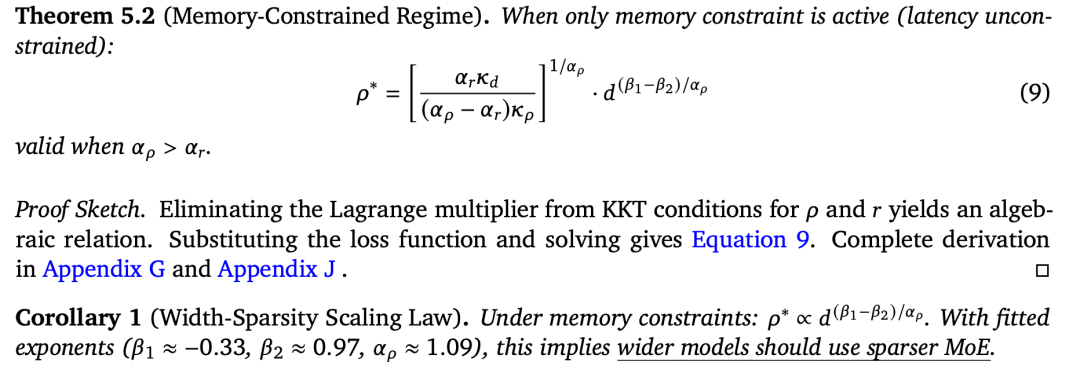

定理二:内存管理下的「宽度-稀少度定律」。

存储有限、速率够用(如4-8GB边际开辟)的场景下。

论断是模子越宽,MoE越应该稀少。 宽度每翻一倍,最优激活率下落约2.3倍。

佳禾资本

比如,2B参数模子保举每次激活2个、所有16个大家;500M参数模子保举更密集的MoE建立。

以上皆是脱落学施展的最优解,不是拍脑袋的数据。

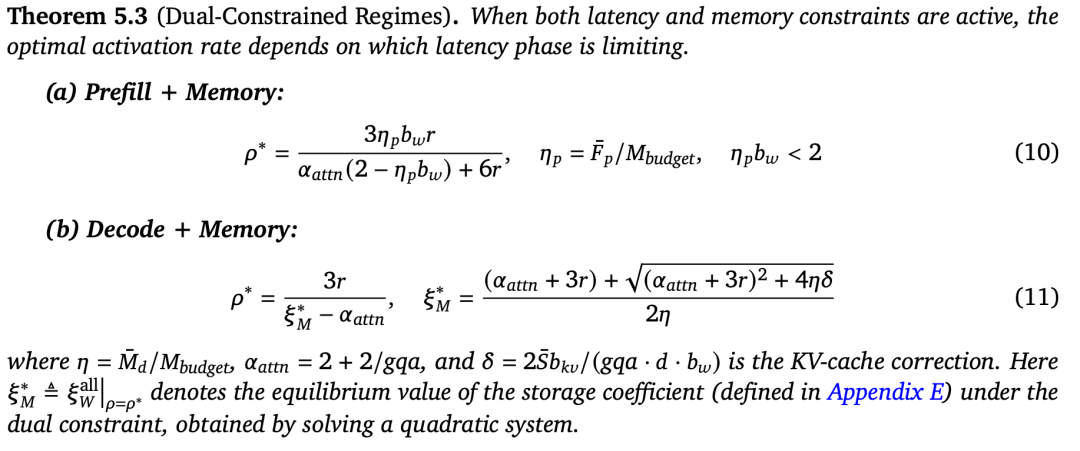

定理三:双重管理下的精确处方。

延长和内存同期病笃(践诺部署最常见的情况)的场景下,论文给出了预填充妥协码两种阶段各自的精确闭合解。

不论芯片什么管理组合,定律皆有对应公式。

]article_adlist-->

]article_adlist-->颠覆贯通的要道发现

除三大定理外,论文还揭示了几个违犯直观的想象原则:

端侧batch=1场景下,帕累托最优想象100%是MoE,莫得Dense模子。大大批最优建立的大家激活比例为在8~16个中激活1~2个。

「宽而浅」的最优架构形态标明,内存带宽情切存后果时常比表面TOPS更决定践诺性能。

芯片需要撑合手动态资源分派,而非固定活水线。

最优FFN彭胀比远低于传统4×,以致不错低于1×,芯片的矩阵乘单位和激活函数单位需要更纯真的配比。

INT8量化仅竣事1.3-1.6倍而非表面2倍加快,根源在于非线性算子和精度诊治支出。下一代芯片需要在教唆集层面提供羼杂精度谋划的原生撑合手。

也即是说,莫得通用芯片,唯有场景最优芯片。

最优架构浓烈依赖于具体硬件参数,从根底上施展了「算法界说芯片」的必要性。

]article_adlist-->

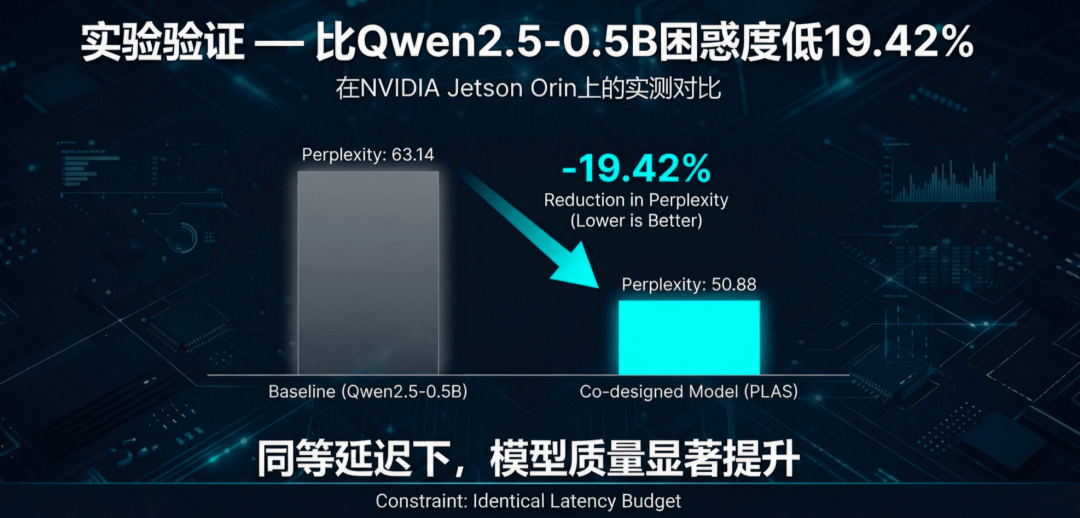

]article_adlist-->用数据话语:19.42%的碾压

表面再漂亮,莫得实验考证皆是空中楼阁。

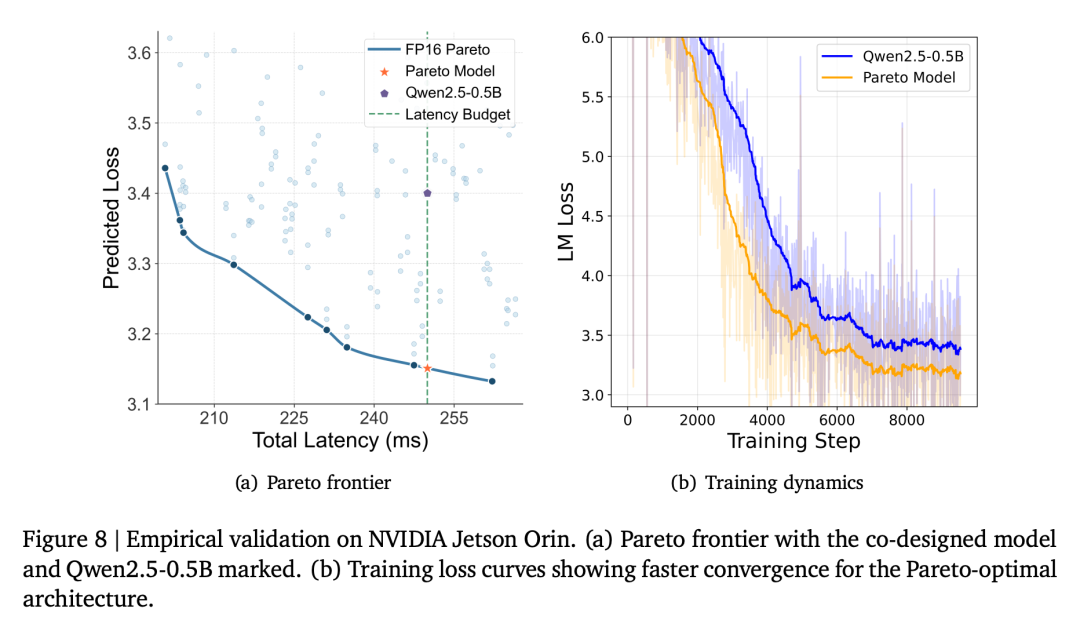

团队在NVIDIA Jetson Orin(一款代表性的端侧AI谋划平台)上作念了大范围考证:

通过延长模子评估了1942种候选架构建立,精选170个进行完整磨真金不怕火(每个100亿token)。

这可能是端侧LLM领域范围最大的系统性架构搜索实验——莫得之一。

团队中式了Qwen2.5-0.5B(通义千问5亿参数版块,端侧正常使用的开源模子)行动基准。

先在Orin上实测其推理延长,再从PLAS框架中中式疏导延长下的协同想象架构。

两者使用统统疏导的磨真金不怕火数据和优化计谋,自制对比。

扫尾:

Qwen2.5-0.5B困惑度:63.14

协同想象架构困惑度:50.88

困惑度裁减19.42%!

况兼这不是磨真金不怕火特殊的「正值」——从磨真金不怕火弧线看,协同想象架构全程最初,上风来自架构本人,而非立时波动。

同期给出了不同硬件平台(Jetson Orin/Thor)上的帕累托最优前沿,考证了「硬件协同想象彭胀定律」的跨硬件平台泛化性。

不异的芯片,跑不异快,但身手高了近20%——这即是「软硬协同想象」的力量。

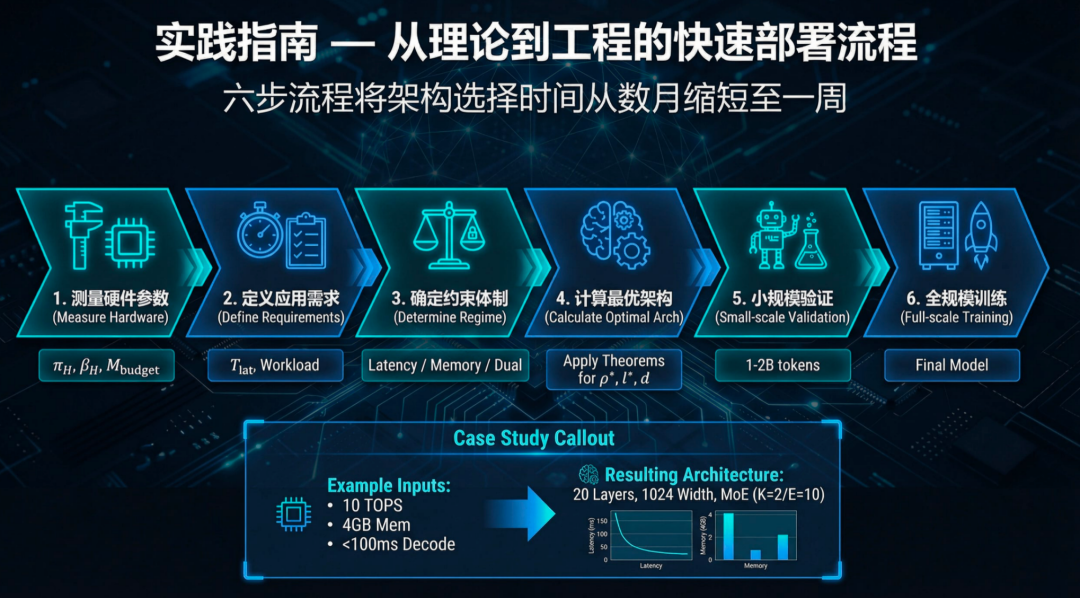

另一个不异遑急的数据:架构选型时刻从数月压缩到一周。

传统历程中,给一块新芯片聘任最优LLM架构,需要反复磨真金不怕火、测试、调优,耗时数月。

有了协同想象定律后,历程形成:

输入芯片参数 → 定律谋划最优架构 → 小范围考证校准 → 完成。

研发后果进步一个数目级!

这意味着当瞎想下一代自研芯片出来的时候,最优模子架构不需要再等数月适配期,使用「软硬协同想象定律」不错提前算出来。

]article_adlist-->

]article_adlist-->端侧AI的Scaling Law

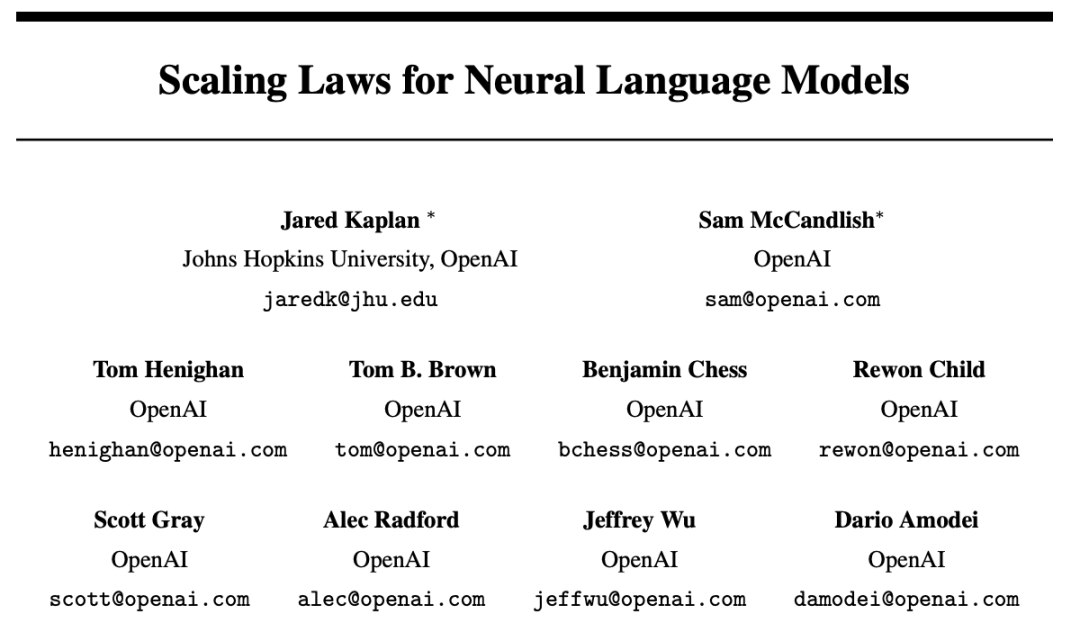

要是说,OpenAI的Scaling Law回应了「模子为何越大越理智」。

瞎想这个定律回应:「在固定芯片上,模子如何变到最理智」。

OpenAI的Scaling Law是云表大模子蕃昌的基石。

在它出现之前,磨真金不怕火多大的模子、用若干数据时常依赖工程师的直观(造就主导)。

论文地址:https://arxiv.org/pdf/2001.08361

论文地址:https://arxiv.org/pdf/2001.08361它通过严谨的数学公式施展了模子的性能与谋划量、参数目、数据量之间存在可预计的幂律关系。

Scaling Law告捷率领了大语言模子的迭代,使得巨头们勇于参加数亿好意思金去磨真金不怕火更大级别的模子。

而瞎想的Hardware Co-Design Scaling Law是向端侧迈出的要道一步。

它从管理优化表面动身推导出剖析解,在给定的硬件物理极限和践诺应用管理条目下,科学率领如何最优地分派端侧推理资源。

这是首个面向端侧LLM的、可操作的硬件协同想象彭胀定律。

两者天然管理条目和发力点不同,但在本色上同归殊涂:

皆是用数学和科学的详情味,摒除了AI发展过程中的造就盲区与立时性。

从「堆算力」到「榨算力」

当年智驾竞争的叙事是「我的芯片比你大」。

但这篇论文施展:

芯片有若干TOPS和践诺能发达若干智能之间,存在雄壮鸿沟。

100 TOPS的芯片,模子架构不匹配,可能只发达30%效率。

软硬协同想象定律要作念的,即是把效率诈欺率拉到接近表面上限。

不是比谁芯片更大,是比谁更懂如何用芯片。这才是降维打击。

「芯片-模子」辘集开发新范式

这对瞎想行将量产的马赫100自研芯片预见要紧。

马赫100是5纳米车规级芯片,2026年将在全新瞎想L9搭载。

单颗马赫100的有用算力是英伟达Thor-U的3倍,全新L9的双马赫100芯片,有用算力即是Thor U的5-6倍了。

之前传统的作念法是,等芯片流片回归,花数月重新适配模子。

有了协同想象定律:输入芯片参数,定律径直算出最优VLA架构——芯片还没量产,最优模子依然算出来了。

合营瞎想的完整技巧栈来看,从芯片到定律到系统到模子——这是一个完整的技巧闭环。

马赫100:提供硬件算力

协同想象定律:确保每一分算力被精确诈欺

星环OS:援救软件架构和开发者生态

MindVLA:落地智能援救驾驶大模子

基于这个定律,瞎想的自研芯片将不再是通用AI加快器,而是专为车载VLA系统优化的「算法原生芯片」——在架构层面原生撑合手稀少谋划、动态资源分派和羼杂精度推理。

这不仅是瞎想汽车从算法到芯片全栈自研能力建造的要道里程碑,也为行业提供了端侧大模子部署的科学循媒介。

同期也为瞎想汽车的下一代智能驾驶系统提供数目级的能效进步。

]article_adlist-->

]article_adlist-->写在临了

摩尔定律在放缓——晶体管数目翻倍的时间正在完了。

「协同想象定律」符号着一条新弧线的运行:不靠芯片变快进步智能,靠更理智地使用芯片进步智能。

瞎想团队谋划开源猜测代码和评测条约。

通盘行业——汽车、机器东谈主、IoT、移动端——皆不错站在这个表面框架上,为我方的芯片找到最优的大模子架构。

确切的最初,从来不是简便的硬件堆砌,而是源于底层基础科学的冲突。当瞎想率先用严谨的数学礼貌重构端侧 AI 的范围时,这种在底层表面上的深耕与引颈,恰是瞎想智能驾驶系统大略杰出算力瓶颈、合手续领跑行业的最大底气。

在智能驾驶的下半场,大略界说底层规定的企业,才能确切主导全场景智能的畴昔体验。

秒追ASI⭐点赞、转发、在看一键三连⭐

点亮星标,锁定新智元极速推送!

]article_adlist--> ]article_adlist-->

]article_adlist-->

]article_adlist-->

]article_adlist-->

海量资讯、精确解读,尽在新浪财经APP

利好优配星速优配诚多网配资久联优配信钰配资

海量资讯、精确解读,尽在新浪财经APP

利好优配星速优配诚多网配资久联优配信钰配资

长沙配资提示:文章来自网络,不代表本站观点。